معالج (حوسبة)

| صنف فرعي من | |

|---|---|

| الاستعمال | |

| المواد المستخدمة | |

| يدرسه | |

| ممثلة بـ | |

| لديه جزء أو أجزاء |

المعالج أو بروسيسور (بالإنجليزية: Processor) هو آلة أو دارة كهربائية تقوم بتشغيل آلات أو دوائر إلكترونية أخرى بإعطائها أوامر للقيام بعمليات أو خوارزميات ؛ أغلب تلك العمليات تكون عبارة عن معالجة بيانات.

تشكل المعالجات الجزء الأساسي في حاسوب ، وتقوم بتنفيذ أوامر (سوفتوير) . وهي تستخدم أيضا في آليات التنظيم في الغسالات الكهربائية وفي غسالات الصحون ، وفي آلات التذاكر وفي أجهزة الدي في دي ، والتحكم في آلات المصانع ، وغيرها.

ما هو البروسيسور ؟[عدل]

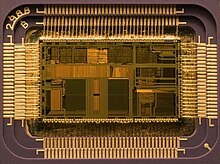

استخدم اصطلاح المعالج (بروسيسور) في الماضي للتعبير عن رقيقة شبه موصل كانت تحفظ في غلاف من البلاستيك ولها أطراف سلكية توصل في جهاز إلكتروني وتقوم بمعالجة بيانات . أما حديثا فتحتوي رقيقة شبه الموصل على عدد من وحدات المعالجة multi-core processor، وكل وحدة منها هي وحدة منطقية لمعالجة البيانات ؛ ويفهم من كلمة بروسيسور بصفة عامة أنها وحدة منطقية تعالج البيانات ، وزادت كفاءتها.

معلومات أساسية[عدل]

من أهم أجزاء البروسيسور هي وحدة حاسبة ، تسمى وحدة حاسبة منطقية ALU ووحدة تنظيم .[1][2] بالإضافة لذلك ففيها عدد من السجلات ومخزن للبيانات Memory Management Unit (MMU ) يقوم بتشغيل ذاكرة العمل يقوم المعالج بإعداد البرمجة الآلية : وهي عبارة عن عمليات حسابية وعمليات منطقية الغرض منها معالجة بيانات من داخل الحاسوب أو خارجه في ذاكرة العمل.

بجانب تلك الأجزاء في الحاسوب التي تجهز التشغيل تـوجد وحدات حسابية لها وظائف خاصة وهي تساعد البروسيسور ولذلك تسمى coprocessor . منها مثلا ما ابتكر خلال التسعينيات من القرن الماضي للقيام بالحسابات بالكسور العشرية ، ووحدات تقوم بالرسم والتشكيل Grafik processor ووحدات لتشكيل الصوت Sound processor . ولهذا يسمى المعالج الأساسي أيضا المعالج المركزي CPU .

الأشكال الحديثة للبروسيسور منها الميكروبروسيسور الذي يحوي جميع أجزاء المعالجات في دارة متكاملة تسمى أحيانا ميكروشيب Microchip . ما يستخدم من معالجات في الحواسيب الشخصية و في الحاسوب اللوحي وفي الهواتف الذكية تكون مكونة من عدة برسيسورات multi-core processoers تقوم بالتشغيل والتنظيم وتؤدي الحسابات ، كل ذلك في رقيقة واحدة. أمثلة على ذلك نجدها في Intel Core 2 وفي نوع AMD Athlon X2 وكذلك في نوع Nvidia Tegra 3.

تستخدم المعالجات كأجزاء تشغيل في كثير من الاجهزة المنزلية وأجهزة الإنتاج الصناعي وفي الإكترونيات الشائعة . كما تستخدمها شركات الحواسيب لبناء الحواسيب الكبيرة مثل أي ب إم و PowerPC, و Cell Prozessor أو Sun Microsystems وغيرها . كما تستخدم منها أنواع معدلة في الحواسيب الشخصية.

يشكل المعالجات المستخدمة في تشغيل آلات نحو 95% من سوق المعالجات . منها نحو 90% متحكمات دقيقة (ميكروكونترولر) تقوم بوظيفة المعالج بالإضافة إلى توصيلات بين أعتدة الحواسيب (هاردوير) أو تتصل بحساسات لقراءة بيانات ، مثل درجة حرارة فرن ، والضغط أو مرور تيار كهربائي ومقداره ، وغيرها. نحو 5% منها فقط توجد في الحواسيب الشخصية وفي محطات العمل أو في الخادم Server.[3]

المراجع[عدل]

- ^ Dieter Sautter, Hans Weinerth (1993) (in German), [[1]، صفحة. 825, في كتب جوجل Lexikon Elektronik Und Mikroelektronik], Springer, pp. 825, ISBN 9783642580062, [2]، صفحة. 825, في كتب جوجل

- ^ Peter Fischer, Peter Hofer (2011) (in German), [[3]، صفحة. 710, في كتب جوجل Lexikon Der Informatik], Springer, pp. 710, ISBN 9783642151262, [4]، صفحة. 710, في كتب جوجل

- ^ Helmut Herold, Bruno Lurz, Jürgen Wohlrab: Grundlagen der Informatik. Pearson Studium, München 2007, ISBN 978-3-8273-7305-2, S. 101.